AI推論時のメモリ消費を圧縮し処理性能を最大8倍に高速化するTurboQuant。需要減を懸念し半導体株は下落したが、基礎的な事業基盤は依然強固であり、不確実性への一時的な過剰反応と評価される。

インフォグラフィック

解説動画

スライド資料

Google、AIのメモリを6分の1に削減する新技術「TurboQuant」発表

2分で音声解説(Spotifyポッドキャスト)

1. エグゼクティブ・サマリー

2026年3月、Googleは大規模言語モデル(LLM)の推論時におけるメモリ消費量を極限まで圧縮する新技術「TurboQuant」を発表した 1。この技術は、AIの演算処理において長らくボトルネックとなっていたメモリの物理的制約をソフトウェア・アルゴリズムのアプローチによって大幅に緩和するものである 1。発表直後、米国の株式市場では「AIモデルのメモリ効率化がハードウェアの総需要減少につながる」との見方が広がり、主要な半導体およびストレージ関連銘柄が軒並み下落する事態となった 1。

本レポートでは、この新技術がもたらす技術的メカニズムと市場の初期反応を検証するとともに、AIコンピューティング需要の構造的な変化について分析する。さらに、日本の半導体製造装置産業や経済環境、企業経営者が直面する戦略的課題、そして個人の日常生活に至るまで、広範な影響を多角的な視点から詳細に論じる。

2. TurboQuant技術の詳細とメカニズム

TurboQuantは、大規模言語モデルの運用において「推論(インファレンス)段階」に特化した圧縮アルゴリズムである 1。LLMがテキストを生成する際、入力された文脈を一時的に保持するためのKey-Valueキャッシュ(KVキャッシュ)が膨大なメモリ容量を占有する 1。TurboQuantは、モデルの回答精度を大きく損なうことなく、このKVキャッシュを3ビットにまで圧縮することを可能にした 1。

この技術的進展により、LLMのキャッシュメモリ使用量は従来と比較して少なくとも6分の1に削減され、同時に推論性能は最大で8倍高速化される 1。これは、同一のGPUおよびハードウェア構成を用いた場合でも、システム全体で処理できる並列タスクの量が劇的に増加することを意味する 1。ベクトル検索やAI推論におけるメモリのボトルネックが解消されることで、単位計算能力あたりの効率は大きく向上する 1。

一方で、この技術が対象としているのはあくまで推論フェーズであり、AIモデルそのものを構築する「学習(トレーニング)フェーズ」には影響を及ぼさない 1。学習段階においては、膨大なパラメータとデータセットを並列処理するために、依然として広帯域幅メモリ(HBM)への強い依存が存在する 1。したがって、大規模なコンピューティングクラスターの重要性や、学習プロセスにおける物理的なメモリ要件がTurboQuantによって直ちに代替・削減されるわけではない 1。

3. 米国市場および半導体関連株への初期インパクト

TurboQuantの発表に対する金融市場の初期反応は、ハードウェア需要のピークアウト懸念を強く反映したものとなった 1。市場参加者は、ソフトウェアによる極端な効率化が、HBM、DRAM、NANDなどの物理的なストレージ容量へのニーズを構造的に減少させると解釈した 1。過去1年間、AIインフラ需要の急拡大を背景にストレージセクターが高いバリュエーションを享受してきたため、需要鈍化の兆しは急速な価格調整(リプライシング)を引き起こした 1。

加えて、メモリ大手のSK Hynixが2026年後半に米国において最大144億ドル規模の資金調達を伴う上場を検討しているとの報道が重なり、市場における供給過剰と競争激化への警戒感が高まったことも、下落圧力を増幅させた要因として挙げられる 1。

以下の表は、ニュース発表直後に影響を受けた主要企業の株価動向と、各社の基礎的な財務指標および市場評価をまとめたものである。

| 企業名 (ティッカー) | 一時下落率 | 専門領域 | アナリスト評価 / ファンダメンタルズの状況 |

|---|---|---|---|

| Seagate Technology (STX) | -8%超 | HDD・データストレージ | 需要鈍化懸念により急落したが、ファンダメンタルズは底堅い 1 |

| Advanced Micro Devices (AMD) | -7.2% | CPU・GPU設計 | 過去5年の収益CAGR 28.8%。Q4収益は前年比34.1%増と好調。高品質な「買い」評価を維持 2 |

| SanDisk (SNDK) | -6.5%〜-8% | フラッシュメモリ製品 | 直近の好決算にもかかわらず、圧縮技術への警戒感から大幅下落 1 |

| Western Digital (WDC) | -6%超 | データストレージ、NAND | 目標株価に対して約10.4%の上昇余地。AIサーバー向け需要が牽引 1 |

| Entegris (ENTG) | -5.6% | 特殊化学品・材料ハンドリング | Q4は予想を上回るも、過去2年の収益が年率4.8%減と苦戦。「アンダーパフォーム」評価 2 |

| Micron Technology (MU) | -5%超 | DRAM、NAND、HBM | 過去3年の年平均収益成長率140%超。データセンター需要により「買い」評価 1 |

| Lattice Semiconductor (LSCC) | -4.8% | FPGA (プログラマブルロジック) | Q4収益は前年比24.2%増。粗利率68.5%と高いが営業利益率に課題 2 |

| Nova (NVMI) | -4.7% | 半導体計測・品質管理システム | 過去5年のEPS CAGR 33.2%、ROIC 29.7%と非常に優秀。高品質な「買い」評価 2 |

このデータが示す通り、多くの企業は直近の四半期決算で市場予想を上回る業績を達成しており、基礎的な事業基盤は依然として強固である 1。たとえば、Micronはデータセンターやエッジ市場におけるAIインフラ需要の増加により、記録的な四半期業績を報告している 3。AMDもデータセンター向けGPUおよびCPUの販売が好調であり、将来的な成長見通しも明るい 2。Novaに至っては、半導体製造の複雑化に伴う計測機器需要の恩恵を受け、極めて高い資本効率性を誇っている 2。

これらの事実を総合すると、市場の初期反応はファンダメンタルズの悪化を反映したものではなく、高値圏にあったハイテク銘柄のバリュエーションに対する一時的な利益確定と、不確実性への過剰反応であったと評価できる 1。

4. AIコンピューティング需要のパラダイムシフト

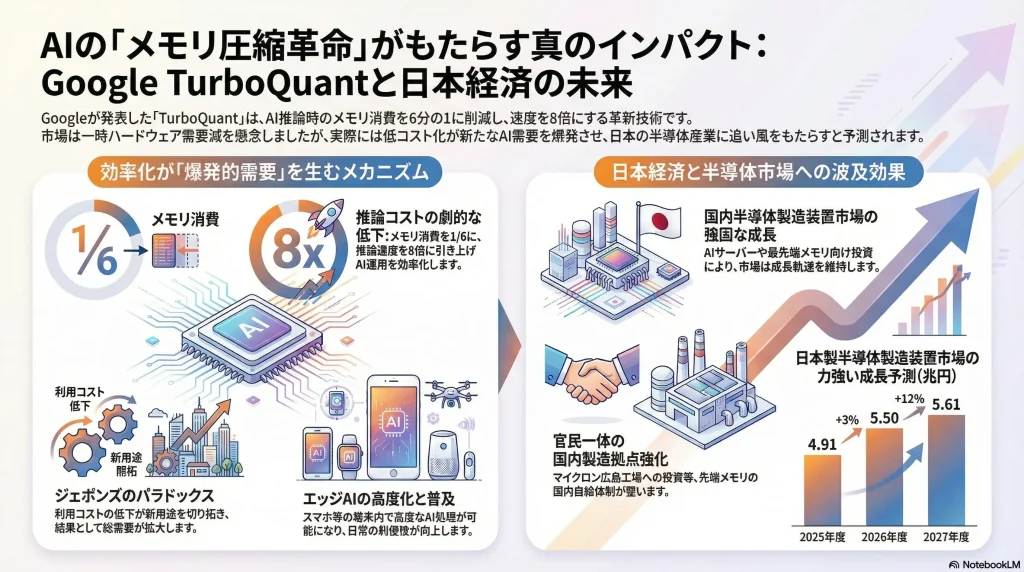

TurboQuantがもたらす影響を中長期的な視点で分析する上で不可欠な概念が、経済学における「ジェボンズのパラドックス(Jevons Paradox)」である 5。この理論は、技術の進歩によって特定の資源を利用する効率が高まると、結果としてその資源の総消費量は減少するのではなく、むしろ増加するという現象を説明する 6。

4.1 効率化がもたらす総需要の拡大

AIの分野においてこのパラドックスを適用すると、推論時のメモリ消費量が削減され、計算効率が向上することは、そのままAIの運用コスト(推論コスト)の大幅な低下を意味する 1。モデルのコストは年間約10倍のペースで低下しており、オープンソースモデルの急速な普及もこのトレンドを後押ししている 5。

医療現場の例を挙げると、AIによる画像診断支援が導入され、放射線科医がより速く正確にスキャンを読影できるようになった場合、単純に考えれば必要な医師の数やシステム稼働時間は減少するはずである。しかし現実には、診断コストの低下と所要時間の短縮により、予防的なスクリーニング検査の実施件数が増加し、新たなユースケースが開拓されることで、画像診断全体の需要はむしろ拡大する 6。

これと同様に、推論インフラのコストが劇的に低下すれば、これまで費用対効果の観点からAIの導入が見送られていた分野(中小企業のバックオフィス業務、個人の日常的なデジタルアシスタント、IoTデバイスでのリアルタイム解析など)への商業化のハードルが下がる 1。結果として、より多くの企業やユーザーがAIを頻繁に利用するようになり、エンドポイントでの推論リクエスト数は爆発的に増加する 1。1回のタスクあたりのメモリ使用量は減るものの、タスクの総量がそれを上回るペースで増大するため、データセンター全体のコンピューティング能力およびストレージの総需要は拡大傾向を維持することになる 1。

4.2 データセンターアーキテクチャの進化

AIデータセンターのワークロードは、2026年から2030年にかけて毎年3倍から4倍のペースで増加すると予測されている 7。これに対応するため、半導体業界は単なるチップの微細化にとどまらず、システムレベルでの統合を進めている。

具体的には、HBMをロジックチップ(GPUやNPU)のより近くに配置するチップレット技術や3Dスタッキングの採用が加速している 7。これにより、データは複数のプロセッサとメモリ間を毎秒数テラバイトという速度で移動できるようになり、消費電力あたりの性能(トークンあたりのワット数など)が向上する 7。また、サーバーラック内やラックスケールでのデータ転送において、従来の銅線イーサネットではAI特有の膨大なトラフィック(East-Westトラフィック)を処理しきれなくなるため、コパッケージドオプティクス(CPO)やリニアプラガブルオプティクス(LPO)などの光インターコネクト技術の導入が不可欠となっている 7。AIネットワークファブリックへの支出は、2024年から2029年にかけて年平均38%の成長が見込まれている 7。

5. 日本経済および景気への影響

Googleの圧縮技術による効率化の波は、日本の主要産業である半導体製造装置市場や材料産業に対しても、需要の質的転換と継続的な投資機会をもたらす。

5.1 半導体製造装置市場の強固なファンダメンタルズ

日本半導体製造装置協会(SEAJ)が2026年1月に発表した予測によれば、日本の半導体製造装置市場は非常に強固なファンダメンタルズに支えられている 8。

| 年度 | 日本製半導体製造装置の売上高予測 | 前年度比増減率 | 市場を牽引する主な要因 |

|---|---|---|---|

| 2024年度 | 4.76兆円 (実績見込) | +29% | AIサーバー向けHBM投資の急激な立ち上がり 8 |

| 2025年度 | 4.91兆円 | +3% | 台湾ファウンドリの2nm(GAA)投資、DRAM投資 8 |

| 2026年度 | 5.50兆円 | +12% | DRAM投資の継続的拡大、先進ロジック向け投資 8 |

| 2027年度 | 5.61兆円 | +2% | AI関連製品の需要高止まりとエコシステムの成熟 8 |

2026年度の売上高予測は5.50兆円(前年比12%増)と大幅な伸びが見込まれており、これは事前の見通しを上方修正したものである 8。成長の主因は、AIデータセンター向けの専用チップ(ASIC)や、引き続き逼迫するHBM向けの設備投資である 8。現在、HBMの生産枠確保が優先される結果、DDR5などの汎用DRAMの供給が圧迫されており、メモリメーカーは生産能力の継続的な増強を迫られている 8。また、スマートフォンやPC向けのロジック半導体においても、エッジAI処理を可能にするためのさらなる微細化とヘテロジニアス・インテグレーション(異種チップ統合)が進んでおり、これが製造装置需要を底上げしている 8。日本国内市場における販売額も2026年度に1.38兆円(前年比5%増)に達すると見込まれている 8。

5.2 経済安全保障と国内製造拠点の強化

地政学的リスクとサプライチェーンの分断リスクを背景に、日本政府は半導体産業の復権と国内製造基盤の強化を推進している 9。AI推論の効率化が進む一方で、その基盤となるハイエンドメモリの需要は構造的に拡大するという予測が、巨額の投資を正当化している。

マイクロン・テクノロジーは、広島工場に対して最大1.5兆円(約96億ドル)規模の投資を実施し、2027年から極端紫外線(EUV)リソグラフィを用いた最先端の「1-gamma」世代DRAMおよびAI向けのHBMの量産を開始する計画である 10。この戦略的プロジェクトに対し、日本政府(経済産業省)は総費用の約36%に相当する最大5,360億円の補助金を交付する方針を決定した 10。

このような官民一体となった大規模投資は、工場の建設需要を喚起するだけでなく、周辺のシリコンウェーハ、特殊化学品、ガスの供給業者から、物流インフラに至るまで、広範な産業エコシステムに対して持続的な波及効果をもたらす。国内での先端メモリの安定供給は、自動車産業をはじめとする日本の主要製造業がDXを推進するための不可欠な基盤となる。

6. とくに影響を受ける業界や分野

6.1 半導体材料および製造装置業界

AIモデルの進化に対応するため、半導体の構造はより複雑化している。次世代のAIモデル(「Agent AI」や「Physical AI」など)の学習と推論を支えるため、GAA(Gate-All-Around)トランジスタ構造への移行や、HBMのさらなる多層積層、そしてBSPDN(Back Side Power Delivery Network:裏面電源供給網)といった高度なアーキテクチャの採用が進んでいる 8。

これに伴い、東京エレクトロンやアドバンテストをはじめとする日本の製造装置メーカー、そして信越化学工業などの材料メーカーは、より微細で精密な加工技術と、三次元パッケージングに対応した計測・テスト技術の提供を通じて、グローバルな半導体サプライチェーンにおいて極めて重要な役割を担い続ける。

6.2 国内AI開発基盤とクラウドインフラ

推論時の計算リソースが大幅に軽減されることは、日本国内のAIベンダーや研究機関にとって大きな追い風となる。これまで、高度な生成AIモデルの運用には天文学的なコストを要するGPUクラスターが必要であったが、TurboQuantのような技術を活用することで、より小規模なインフラで効率的にサービスを提供できるようになる 1。

日本国内の動向を見ると、Preferred Networks(PFN)などの企業が独自の生成AIモデルの開発を加速させている。PFNは2026年3月に、論理的思考に特化した国産モデル「PLaMo 3.0 Prime」のモニター提供を開始し、同時に直接水冷方式を用いた高密度AIサーバーの実装など、超高効率計算基盤技術の研究開発を進めている 12。

また、経済産業省が主導するNEDOの懸賞金活用型プログラム「GENIAC-PRIZE」では、国産のAI基盤モデルを活用した社会課題解決に向けた開発が助成されている 13。例えば、ダイキン工業などが参加するプロジェクトでは製造業の職人の暗黙知をAIエージェント化する試みが評価されており、三菱重工業や通信インフラ企業なども、独自の専門データを用いたAIサービスの社会実装を進めている 13。推論効率の向上は、こうした国産AIソリューションの運用コストを下げ、普及速度を加速させる。

7. 個人の日常生活において影響があるか

クラウドサーバー側の効率化とモデルの圧縮技術は、一般消費者の日常生活にも直接的な恩恵をもたらす。

7.1 エッジAI(オンデバイスAI)の高度化とデバイス価格への影響

最も顕著な変化は、スマートフォンやパソコンといった消費者向け端末の機能向上である。現在、AI処理の多くは通信を通じてクラウド上のサーバーで行われているが、推論メモリの圧縮が進むことで、端末の内部(エッジ)で直接AIモデルを稼働させることが容易になる。

これまで、スマートフォンの製造コストにおいてメモリチップの価格高騰は大きな圧迫要因となっており、一部のメーカーでは出荷目標の下方修正や端末価格への転嫁が見られた 11。しかし、圧縮技術によって必要なメモリ搭載量の要件が緩和されれば、ミドルレンジやローエンドの端末であっても、高度なリアルタイム翻訳、画像処理、パーソナルアシスタント機能を搭載することが可能となる。また、端末内で処理が完結するため、通信環境に依存しない迅速なレスポンスが得られ、プライバシーの観点からも個人情報が外部サーバーに送信されないという大きな利点が生じる。

7.2 日常的なサービスの質の向上

インフラコストの低下は、企業が提供するサービスの価格低下や品質向上として消費者に還元される。多くの企業が顧客サポートにAIチャットボットを導入することで、消費者はコールセンターの長時間の待機から解放され、24時間いつでも的確なサポートを受けられるようになる 15。さらに、前述した医療分野における画像診断の精度向上と検査コストの低下は、予防医療へのアクセスを容易にし、個人の健康寿命の延伸に寄与する 6。AIの恩恵は、一部の専門家や企業だけでなく、日常のあらゆる場面へと急速に浸透していく。

8. 日本の企業経営者はどのような事業戦略を取るべきか

ハードウェアの限界をソフトウェアで克服し、AIの利用コストが劇的に低下するこのパラダイムシフトに対し、日本の企業経営者は以下のような戦略的対応を急ぐべきである。

8.1 導入ハードルの低下を活かしたアジャイルな業務変革

AIの運用コスト低下は、大企業に限らず中小企業においても、全社的なデジタルトランスフォーメーションを推進する好機である 16。経営者は大規模なシステム開発に頼るのではなく、既存のクラウドサービスや小規模なAIツールを活用した「小さく始めて成果を出す」アジャイルな戦略を採用すべきである 16。

| 部門・業務 | AI活用の具体例 | 期待される戦略的効果 |

|---|---|---|

| マーケティング | 顧客の利用履歴や多次元データを解析し、高反応のターゲット層を抽出 17 | 従来の属性分類より2倍以上の効果的な販促。PDCAの高速化と資源の集中投下 17 |

| 品質保証・製造 | 生産ラインの材料画像を解析し、不良品や異常を自動検知 15 | 不良品率の低減、目視検査の人的コスト削減。年間数百万単位のコスト圧縮 15 |

| 顧客対応・サポート | ナレッジデータベースと連携したチャットボットによる顧客対応や社内FAQの自動化 15 | 問い合わせ対応時間の短縮と対応品質の均一化。人的負担の軽減 15 |

| 現場主導のデータ分析 | 専門知識が不要なUIを持つ予測分析ツールを現場担当者に提供 17 | 中央部門への依存脱却。現場レベルでの迅速な意思決定とデータ活用文化の浸透 17 |

これらの導入によって削減された時間とコストは、より戦略的な企画業務や新商品開発などの高付加価値業務へと再投資することで、企業の持続的な成長サイクルを確立することが重要である 15。

8.2 サプライチェーン・セキュリティの体制強化

AIの普及により企業間のデータ連携が深まる中で、サイバーセキュリティの確保は経営課題の核心に位置づけられる。経済産業省は2026年3月に「サプライチェーン強化に向けたセキュリティ対策評価制度(SCS評価制度)」の制度構築方針を公表した 13。

この制度は、サプライチェーン全体(クラウド環境を含む)のセキュリティ対策を、共通の基準(星3、星4など)に基づいて客観的に評価し可視化するものである 13。特に星3(★3)レベルでは、専門家の確認を伴う自己評価が求められ、中小企業向けには「サイバーセキュリティお助け隊サービス」の新類型や、情報処理安全確保支援士による適合性確認などの支援策が用意される 13。

大企業は自社の防御力を高めるだけでなく、取引先に対してこのSCS基準に基づくセキュリティ対策を求める傾向が強まる。したがって、中小企業を含むすべての経営者は、これを単なるコストとみなすのではなく、事業継続と取引関係維持のための必須要件(コンプライアンス)として認識し、早期に体制整備に着手しなければならない 13。

8.3 「コモディティ化するAI」に対する競争優位の再定義

TurboQuantのような技術革新によって、高度なAIモデルを稼働させること自体の技術的・コスト的ハードルは下がり、AIの演算能力そのものは電気や水道のようなインフラへと変化していく 1。この環境下において、「他社より優れた汎用AIを使っていること」はもはや持続的な競争優位の源泉とはならない。

日本の経営者が注力すべきは、一般に利用可能なAIインフラに対して、長年の事業活動を通じて蓄積された自社固有の「クローズドデータ」や「ドメイン知識(暗黙知)」をいかに掛け合わせるかという点にある 13。例えば、製造業における熟練工の溶接技術の形式化や、特定の顧客基盤に対する深い洞察など、AI単体では学習できないリアルなデータこそが価値を持つ 13。デジタル空間での推論結果を基に、物理空間で確実にオペレーションを実行する現場の遂行能力を磨き上げることが、模倣困難な企業の強みとなる。

9. 結論

Googleが発表した推論メモリ圧縮技術「TurboQuant」は、AIハードウェア市場において一時的な調整を引き起こしたものの、本質的にはAI産業の進化において必然かつ極めて前向きな技術的ブレイクスルーである 1。ハードウェアの物理的制約をソフトウェアのアルゴリズムによって克服することで、AIインフラの資本効率は飛躍的に向上する 1。

市場が懸念した「需要のピークアウト」は近視眼的な見方であり、ジェボンズのパラドックスが示す通り、推論コストの低下はこれまで想定されていなかった新たな用途を切り拓き、コンピューティング能力とストレージに対する総需要をむしろ拡大させる力学として働く 1。

日本経済においては、DRAMやHBM、先進ロジック向け設備投資の拡大により、半導体製造装置産業が力強い成長を続けるとともに、国策としての国内製造拠点整備が産業全体に波及効果をもたらす 8。同時に、エッジデバイスの進化やサービスの低廉化を通じて、AIの恩恵は個人の日常生活の隅々にまで行き渡る。

日本の企業経営者は、この技術革新がもたらす「AIの民主化」をいち早く捉え、スモールスタートによる業務の抜本的な効率化を推し進めるとともに、SCS評価制度などの新たな基準に適応した堅牢なサプライチェーンを構築することが求められる 13。そして、誰もが高度なAIを利用できる時代においてこそ、自社固有のデータと現場の実装力という「人間と組織にしか生み出せない価値」を磨き上げることが、次世代における持続的成長の要となる。

引用文献

- Googleの「圧縮革命」がAIコンピューティングのロジックに影響 …, https://www.tradingkey.com/jp/analysis/stocks/us-stocks/261721390-google-ai-turboquant-memory-storage-chips-dram-nand-inference-markets-tradingkey

- Nova, Lattice Semiconductor, IPG Photonics, AMD, and Entegris …, https://stockstory.org/us/stocks/nasdaq/nvmi/news/why-up-down/nova-lattice-semiconductor-ipg-photonics-amd-and-entegris-shares-plummet-what-you-need-to-know

- Micron rides AI memory boom as pricing power lifts forecasts | S\&P Global, https://www.spglobal.com/market-intelligence/en/news-insights/research/2026/03/micron-rides-ai-memory-boom-as-pricing-power-lifts-forecasts1

- Micron Q2 FY 2026 Earnings Driven by AI-Led Memory Demand – The Futurum Group, https://futurumgroup.com/insights/micron-q2-fy-2026-earnings-driven-by-ai-led-memory-demand/

- Semicon China 2026: AI efficiency fuels demand growth under Jevons paradox, AMD warns, https://www.digitimes.com/news/a20260326VL208/amd-demand-2026-semicon-china-growth.html

- Jevons Paradox in Action: How AI Efficiency Drives More Demand – Medium, https://medium.com/design-bootcamp/jevons-paradox-in-action-how-ai-efficiency-drives-more-demand-5184942fbc3c

- 2026 Global Semiconductor Industry Outlook – Deloitte, https://www.deloitte.com/us/en/insights/industry/technology/technology-media-telecom-outlooks/semiconductor-industry-outlook.html

- Market Forecast Report Semiconductor and FPD Manufacturing …, https://www.seaj.or.jp/english/file/jan2026seajforecastforpress_e.pdf

- pwc-semiconductor-and-beyond-2026-full-report.pdf, https://www.pwc.com/gx/en/industries/technology/pwc-semiconductor-and-beyond-2026-full-report.pdf

- Micron Technology (MU) Stock: Climbs as Japan Greenlights $9.6B Memory Chip Plant | MEXC News, https://www.mexc.com/news/208240

- Micron says AI-driven memory crunch is ‘unprecedented’ – The Japan Times, https://www.japantimes.co.jp/business/2026/01/19/tech/micron-ai-memory-crunch/

- ニュース|株式会社Preferred Networks, https://www.preferred.jp/ja/news/

- ニュースリリース (METI/経済産業省), https://www.meti.go.jp/press/index.html

- 【2026年】半導体市場の見通しと予測|注目すべき5つのポイント – note, https://note.com/handoutainews/n/na208da428ecf

- 【2026年最新】生成AI活用で業務効率30%アップ!未来志向企業の成功事例11選, https://service.is-c.jpn.panasonic.com/column/generative_ai

- 【最新】中小企業での生成AI導入ガイド | HP Tech\&Device TV, https://jp.ext.hp.com/techdevice/ai/ai_explained_41/

- 【2026年最新】AIを活用して業務効率化する方法は?AIの活用事例から注意点まで徹底解説, https://www.c3reve.co.jp/post/ai-efficiency